CNN ARIS

|

Automatisation de l’analyse de données des caméras acoustiques par réseaux de neurones convolutifs (CNN) |

|

Recherche

Contexte et problématique

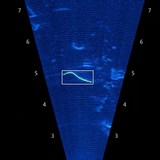

Les sonars multi-faisceaux à très haute fréquence, ou caméras acoustiques, permettent d'obtenir des images de poissons sur lesquelles des caractéristiques morphologiques et comportementales peuvent être extraites, même en eau turbide. Bien que des techniques d’imagerie optique soient déjà utilisées par les gestionnaires pour suivre et compter les populations de poissons migrateurs, l’utilisation de nouvelles caméras acoustiques et le récent développement de nouveaux outils d’analyse de données basés notamment sur les réseaux de neurones permettent d’envisager une amélioration significative des méthodes de suivi par les gestionnaires.Objectifs

Ce projet, financé par l’Agence Française pour la Biodiversité, vise à développer des méthodes de réseaux de neurones profonds (Deep Learning) notamment basées sur les CNN (Convolutional Neural Networks) pour identifier et caractériser les espèces de poissons. Les objectifs scientifiques sont la détection automatique de poissons sur les enregistrements de caméras acoustiques, et une identification des espèces en fonction de critères morphologiques (taille, forme...) et comportementaux (direction, ondulation, vitesse de passage...).Méthodologie

Le développement de cette automatisation met en œuvre des approches innovantes de traitement d'images, via les réseaux de neurones convolutifs (CNN). Le développement de ces outils s’appuie sur les données acquises par l’UMR ESE (Ecologie et santé des écosystèmes) dans le cadre d’études préalables, financées par l’Agence Française de Biodiversité. Un grand nombre d’images a déjà été labellisé, ce qui favorise les capacités d’apprentissage. De plus, bien que les données issues des caméras acoustiques soient complexes et peu courantes, le faible nombre de classes d’objets à identifier (poisson ou non, petit nombre d’espèces) rationnalise les objectifs de ce projet. En plus des images, des données complémentaires seront utilisées par les CNN comme des descripteurs de mouvements ou des données expertes liées à la reconnaissance d’espèces.Résultats attendus

Au terme de ce projet, de nouveaux outils d’analyse des fichiers enregistrés par les caméras acoustiques seront mis au point, à destination des utilisateurs de ces outils de la communauté scientifique ou des gestionnaires de milieux aquatiques. Les outils développés visent à lire automatiquement les vidéos, à en extraire les séquences lors desquelles sont détectés les poissons et à les classer en fonction des caractéristiques de leur passage et de leur morphologie, idéalement en fonction de leur espèce.Personnes impliquées

|

FERNANDEZ GARCIA Guglielmo, Post doctorant(e)

Email : guglielmo.fernandez-garcia@inrae.fr |

|

MARTIGNAC François, Ingénieur(e) de recherche

Téléphone : +33 2 23 48 56 25 Email : francois.martignac@inrae.fr |

|

NEVOUX Marie, Chargé(e) de Recherche

Téléphone : +33 2 23 48 50 15 Email : marie.nevoux@inrae.fr |

Partenaires

Thomas Corpetti UMR LETG :

Littoral - Environnement - Télédétection - Géomatique